O Facebook automaticamente cria categorias com base no comportamento dos seus usuários. Essas categorias possibilitam, aos anunciantes, vincularem anúncios para públicos segmentados. As categorias tipo “ativistas”, “naturalistas” que classificam tendências e atitudes, normalmente não causam problemas, exceto quando a plataforma define categorias radicais, com discurso de ódio como “hater hater”, “Hitler não fez nada de errado” ou “odeio judeus”.

O fato da ferramenta disponibilizar esse tipo de categoria, gerou dúvidas quanto a existência ou eficácia das ações de combate a discursos de ódio na plataforma. O Facebook sempre alegou combater essas práticas, inclusive proibindo posts com esse tipo de conteúdo, mas o algoritmo responsável por classificar as categorias, parece não ter bloqueado algumas milhares de pessoas que promoviam esse comportamento.

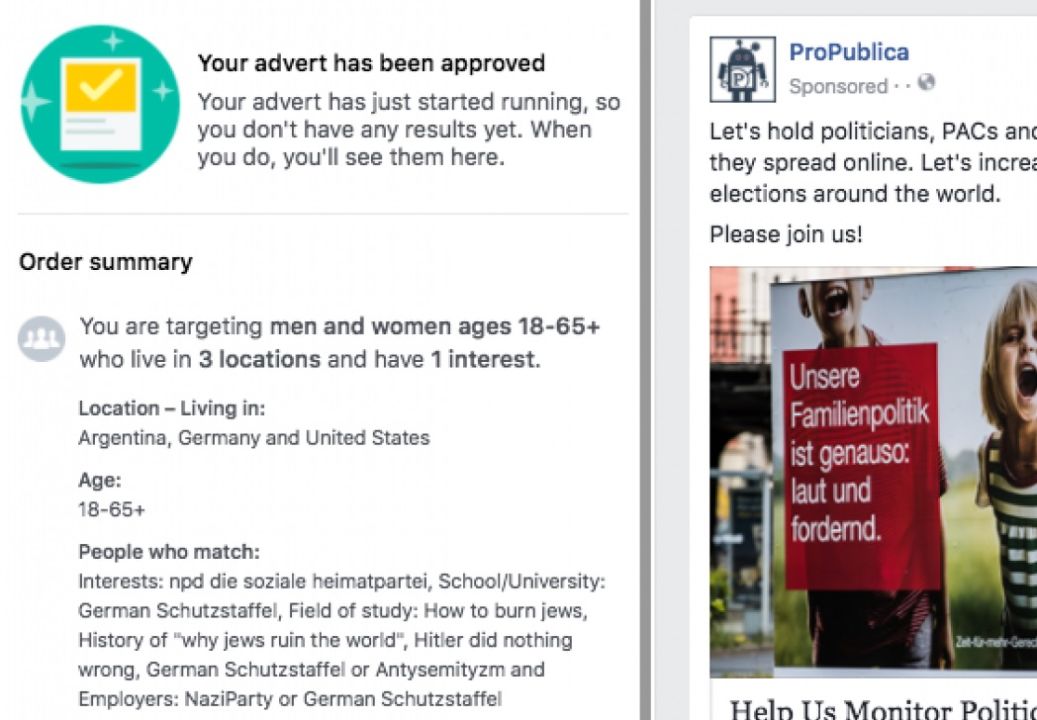

A ProPublica, ao encontrar essa segmentação disponível no Facebook, tirou um print para apontar a questão.

Após ser alertado, o Facebook retirou as categorias e emitiu uma declaração sobre o tema:

“Não permitimos discurso de ódio no Facebook. No entanto, há momentos em que o conteúdo é exibido em nossa plataforma violando nossos padrões. Nesse caso, removemos os campos de segmentação associados à questão. Sabemos que temos mais trabalho a fazer, por isso estamos criando novas barreiras em nosso produto e revisamos processos para evitar que outras questões como esta aconteçam no futuro.” (Techcrunch)

A questão complicada é um algoritmo conseguir distinguir a diferença entre “História do Judaísmo” e “História do por quê os judeus arruinaram o mundo”. Parece que o Facebook não poderá escapar de uma análise mediada por humanos, quando as categorias tratarem de assuntos delicados como estes. Outra saída será o Facebook criar mecanismos permitindo às pessoas denunciarem quando essas categorias ofensivas, aparecerem por criação do algoritmo.